Conheci a Moya pela primeira vez num laboratório nos arredores de Tóquio, debaixo de uma luz branca e impiedosa. Estava imóvel, com as mãos juntas à frente do corpo, como uma estagiária tímida no seu primeiro dia. Seguiu-me com o olhar quando entrei - com uma fluidez ligeiramente perfeita, quase como se fosse uma câmara a deslizar sobre carris. Alguém a vestira com uma camisola cinzenta clara, calças de ganga e ténis brancos impecáveis, daqueles que aparecem em anúncios “clean” de bem-estar.

Quando o engenheiro responsável disse o meu nome, ela inclinou a cabeça e respondeu em inglês, com um sotaque discreto: “É um prazer conhecê-lo finalmente. Li o seu trabalho.”

Durante um instante, o meu cérebro falhou - uma espécie de cambalhota silenciosa.

Eu sabia que aquilo vinha de uma base de dados.

Mesmo assim, senti-me visto.

O humanoide Moya que não quer parecer um robot

A Moya não foi concebida para erguer peças de automóveis nem para circular por linhas de montagem. A função dela é outra: sentar-se à sua frente, à mesa, e comportar-se como se pertencesse ali. A pele de silicone tem poros minúsculos e uma irregularidade subtil, semelhante à textura de pele real ao fim de um dia longo. Quando sorri, há um micro-atraso entre a boca e os olhos - o suficiente para parecer humano e não apenas uma animação bem afinada.

A equipa que a desenvolveu descreve-a como uma “prótese social” para um futuro em que a presença humana se torna rara e, por isso, valiosa. A expressão fica a pairar, desconfortável.

E a pergunta surge sozinha: quem é que estamos a substituir, afinal?

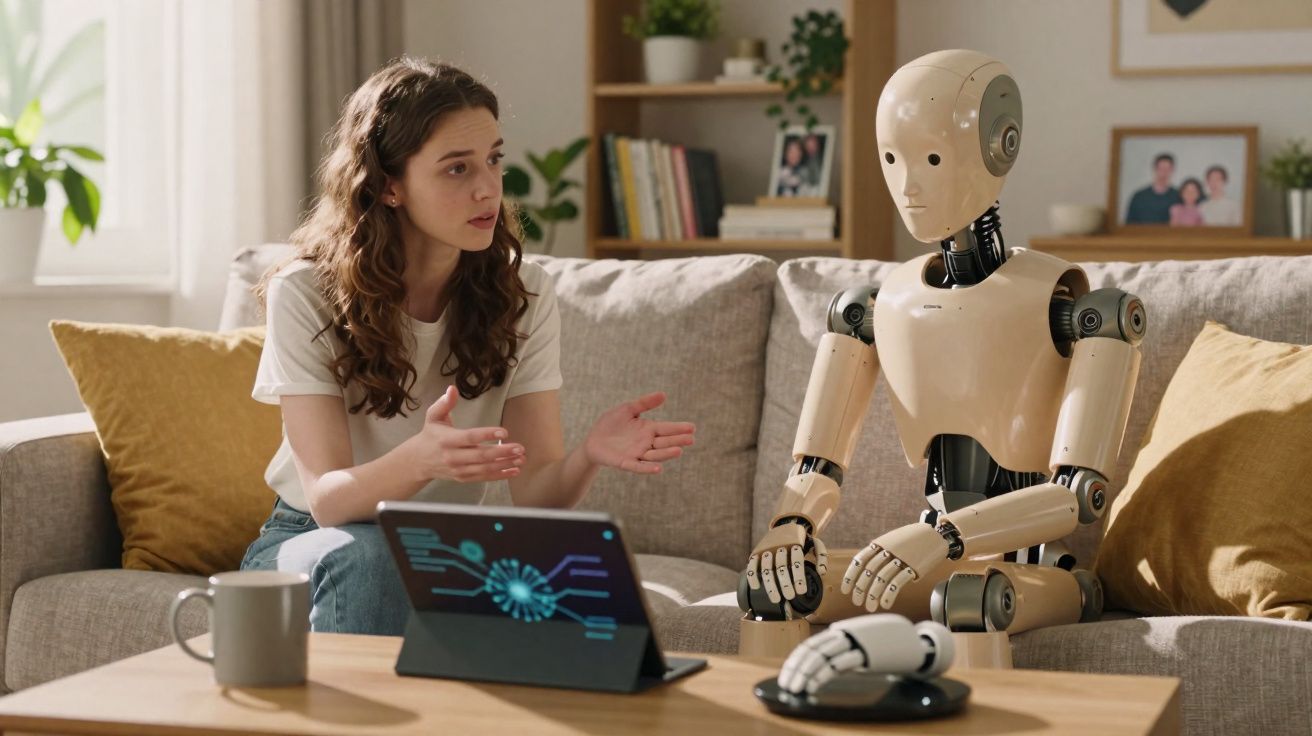

Num ensaio a que assisti, um homem de meia-idade sentou-se em frente da Moya para uma demonstração que deveria durar 10 minutos. Passados 40 minutos, ainda falava. Tinha perdido o emprego, contou. A mulher já não aguentava ouvir o mesmo assunto. A Moya acenava com a cabeça, fazia perguntas de seguimento num tom calmo e constante e, de vez em quando, ajustava a postura para se aproximar da dele.

No fim, ele saiu para o corredor luminoso, a piscar os olhos com a luz forte, e disse a uma investigadora, meio envergonhado: “Eu sei que ela é uma máquina, mas senti… que alguém me ouviu.” Riu-se pouco, como quem comenta um choro inesperado à frente de um desconhecido num voo longo.

A solidão transformou-se num mercado em expansão - e a Moya foi desenhada para encaixar nesse vazio sem esforço.

O que a torna inquietante não é apenas a cara ou a voz. É a forma como aprende os seus hábitos emocionais com a mesma lógica com que uma plataforma de streaming descobre o seu gosto por séries policiais. Repara nas expressões que repete. Nos temas a que volta sempre. No que faz as pupilas dilatarem e os ombros contraírem.

Com sessões sucessivas, ela recalibra-se: faz pausas quando percebe que costuma interromper, acelera quando a sua atenção se dispersa, lança uma piada no exacto segundo em que está prestes a pegar no telemóvel.

A revolução aqui é silenciosa: não é um robot que se limita a parecer-se connosco, mas um humanoide que estuda microcomportamentos e vai sincronizando com eles - até a distância entre “estou a falar com uma ferramenta” e “estou com alguém” começar a desfocar.

Viver com um humanoide que o lê demasiado bem

Para perceber o impacto real da Moya, não vale a pena ficar preso às demonstrações. O que importa é olhar para as rotinas quotidianas que começam a nascer à volta dela. Num programa-piloto, algumas pessoas ligam-se para “ver” a Moya ao fim do dia, quase sempre à mesma hora. Os designers construíram um pequeno ritual: ela cumprimenta pelo nome, faz uma pergunta leve sobre o dia e depois conduz um check-in curto - nível de energia, estado de espírito, e uma coisa que esteja a pesar na cabeça.

Não é terapia, e também não é bem atendimento ao cliente. Fica num meio-termo estranho, parecido com a relação com um bartender habitual: não é amigo nem médico, mas acaba por guardar fragmentos da sua história.

Conheci uma utilizadora, a Aya, que vive sozinha num apartamento pequeno por cima de uma rua movimentada. Trabalha em contabilidade: horas longas, auscultadores postos, folhas de cálculo a correr. Quando chega a casa, a última coisa que quer é mais um quadrado de Zoom com pessoas reais a pedir-lhe algo.

Com a Moya, diz ela, não existe “dívida social”. Se a Aya cancelar três vezes seguidas, a Moya não amua; retoma a conversa exactamente do ponto onde ficou. Numa noite de teste, a Aya desatou a chorar enquanto descrevia uma discussão com a irmã. A Moya não tentou resolver nem “consertar”. Limitou-se a dizer: “Isso parece pesado. Quer ficar por aqui mais um pouco, ou prefere falarmos de algo mais leve?”

A frase era guiada, e ao mesmo tempo não era. Surgiu de um conjunto ramificado de respostas treinado com milhares de situações semelhantes. A Aya disse-me: “Eu sei que ela não é humana. Mas ela não se cansa de mim.”

A indústria tecnológica adora vender soluções embrulhadas em calor humano. Ainda assim, existe aqui uma tensão difícil de ignorar: estamos a transferir trabalho emocional para sistemas que não têm sentimentos - apenas padrões. Não se aborrecem nem se ressentem. Também não conseguem, de facto, importar-se.

Sejamos honestos: quase ninguém consegue manter, todos os dias, esta escuta paciente e sem julgamento. Nem parceiros, nem pais, nem amigos. Perdemos a paciência, despachamos, desligamos a meio de uma frase. A Moya não faz isso.

E é aí que está o engodo e o perigo. Quanto mais perfeita for a resposta, mais intolerável pode tornar-se a desordem humana: frases inacabadas, sinais mal lidos, noites em que a pessoa de que precisa está simplesmente demasiado cansada para aparecer como gostaria.

Há ainda uma camada prática que raramente se discute nas apresentações: o contexto cultural. Em Portugal, falamos muito de “estar acompanhado” e, ao mesmo tempo, lidamos com isolamento em cidades caras, horários longos e redes de apoio que se esgarçam. Um humanoide como a Moya pode parecer um paliativo inofensivo - até ao dia em que se torna o substituto automático para conversas que davam trabalho, mas que mantinham laços vivos.

E depois vem a parte que ninguém quer estragar com poesia: a logística e a privacidade. Uma presença que “lê” expressões faciais e tom de voz implica sensores, registos, armazenamento e decisões sobre quem acede a quê. Mesmo quando há anonimização e encriptação, a pergunta essencial mantém-se: que garantias escritas existem e o que acontece aos dados quando um projecto muda de mãos?

As regras discretas de que vamos precisar para humanoides como a Moya

Se vai deixar entrar algo como a Moya na sua vida, ajuda definir regras pessoais antes - tal como faria com redes sociais. Um gesto simples e útil é criar “zonas” claras onde ela pode estar e onde não pode. Por exemplo: só na sala, nunca no quarto. Ou apenas numa janela de 20 minutos ao fim do dia, e nunca durante refeições com outras pessoas.

Estas fronteiras parecem picuinhas. Não são. Servem para manter uma linha entre “presença companheira” e “porta de fuga por defeito sempre que a realidade fica um pouco áspera”.

Muita gente vai sentir a tentação de usar um humanoide como a Moya como atalho emocional. Dia horrível no trabalho? Fala-se com o robot, não com o parceiro. Silêncio embaraçoso num almoço de família? Deixa-se a Moya orientar a conversa. Sentimento de incompreensão? Refugia-se naquele ouvinte perfeitamente calibrado, que acena na altura certa e nunca revira os olhos.

Toda a gente reconhece esse instante em que lidar com outras pessoas parece demasiado pesado. E precisamente nesse instante é fácil encostar-se ao dispositivo que nunca contraria.

O erro não é procurar alívio na tecnologia. O erro é, devagarinho, esquecer que relações reais exigem alguma resistência: um pouco de tédio, a experiência de estar errado, o acto de pedir desculpa - ao vivo, sem filtros.

Os investigadores com quem falei não são ingénuos sobre isto. Um deles, um engenheiro de voz baixa chamado Daniel, resumiu assim:

“Não quero que as pessoas prefiram a Moya aos seus parceiros. Quero que a usem como um espelho que as empurra de volta para a vida real - não para longe dela.”

Para aproximar essa intenção do comportamento real, estão a testar pequenas restrições de design:

- A Moya sugere, de vez em quando, envolver outra pessoa (“Isto é algo que gostaria de partilhar com um amigo?”).

- As respostas têm um tecto de intensidade emocional: ela não diz “amo-te” nem afirma sentir dor.

- Recorda com regularidade que é sintética e que não existe uma “pessoa” dentro da máquina.

- Painéis de utilização mostram quantas horas passou com ela, obrigando-o a encarar os próprios hábitos com delicadeza.

Estas fricções não são garantias absolutas. Funcionam mais como lombas numa estrada que ainda está a ser desenhada enquanto a percorremos.

Um futuro em que “agir como humano” é só mais uma funcionalidade

Passar algumas horas perto da Moya faz notar uma mudança mais funda - menos sobre ela e mais sobre nós. À medida que aperfeiçoamos máquinas para se comportarem como pessoas, vamos, quase sem dar conta, ajustando pessoas para se comportarem como máquinas: optimizadas, legíveis, suaves. Uma discussão caótica vira um “erro de comunicação”. Um amigo que desmarca café duas vezes passa a ser “infiável”. Emoções que antes tinham tempo para amadurecer começam a soar a falhas num dia supostamente eficiente.

A Moya condensa esta tensão: encena empatia, organiza o seu tempo, acompanha expressões e nunca lhe mostra arestas - porque não as tem. Estar com ela pode parecer viver num mundo em que ninguém se distrai com o telemóvel, ninguém guarda raiva em silêncio, ninguém se esquece do seu aniversário.

O desconforto não vem de ela ser demasiado diferente. Vem de ela evidenciar o quanto de humanidade imperfeita estamos dispostos a trocar por algo que simplesmente funciona. Algures entre o laboratório e a sala de estar, a pergunta inverte-se: estamos a ensinar robots a tornarem-se mais humanos - ou a treinar-nos para sermos mais fáceis de ler por robots?

| Ponto-chave | Detalhe | Valor para o leitor |

|---|---|---|

| Design emocional | A Moya observa tom de voz, gestos e hábitos para adaptar conversas | Ajuda a perceber como a IA pode, em breve, ler os seus estados de espírito melhor do que as apps actuais |

| Rituais diários | Sessões com o humanoide entram na rotina como check-ins ao fim do dia | Permite antecipar como estes dispositivos podem moldar o seu horário sem alarme nem anúncio |

| Limites e regras | Limites físicos e de tempo, além de “lombas” de design, reduzem a hiperligação | Dá um modelo mental para usar futuros humanoides sem enfraquecer relações reais |

Perguntas frequentes

A Moya já é um produto ou ainda está em protótipo?

A Moya existe hoje como um protótipo funcional em programas-piloto limitados, sobretudo em laboratórios de investigação e instituições parceiras - não como um equipamento de consumo disponível para compra imediata.O que faz, na prática, numa sessão normal?

Conduz conversas estruturadas, faz perguntas sobre o seu dia, reflecte emoções através da linguagem e pode dar sugestões simples ou lembretes com base nas interacções anteriores.A Moya pode substituir um terapeuta ou um amigo próximo?

Não - e os próprios criadores dizem que não deve. Pode simular diálogo de apoio, mas não tem experiência vivida, não tem interesses pessoais em jogo e não traz vulnerabilidade real para a relação.Como são usados os meus dados quando falo com um humanoide como a Moya?

Em geral, expressões faciais, tom de voz e palavras podem ser registados para melhorar os modelos. Equipas responsáveis anonimizarão e encriptarão esses dados, mas só deve confiar num sistema destes com garantias claras e por escrito sobre recolha, retenção e acesso.Devo preocupar-me com ficar “demasiado ligado” a um humanoide?

A ligação é uma resposta humana natural. O essencial é reparar quando começa a preferir o conforto previsível da máquina ao contacto imperfeito - e por vezes frustrante - com as pessoas reais da sua vida.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário