Enquanto muitos conselhos de administração ainda estão a polir documentos estratégicos, no terreno a realidade já mudou: colaboradores usam diariamente o ChatGPT e outras ferramentas de inteligência artificial (IA). É cómodo, rápido e, por vezes, impressionante - mas pode tornar-se extremamente perigoso para segredos comerciais e dados de clientes. Por isso, um número crescente de empresas está a tentar pôr ordem na utilização, criar programas de formação em IA e definir um enquadramento claro para a inteligência artificial.

Muitas empresas sentem, ao mesmo tempo, fascínio, sobrecarga - e a percepção de que chegaram tarde ao tema da IA.

O boom da formação em IA nas empresas (ChatGPT, proteção de dados e segredos comerciais)

Seja numa PME seja num grande grupo, em poucos meses apareceu um verdadeiro mercado de formação em IA que está a levar formadores e consultoras ao limite. Há agências que relatam várias sessões por semana - nalguns casos, chegam a realizar três formações no mesmo dia. A procura vai de cursos introdutórios a módulos especializados para jurídico, vendas ou recursos humanos.

As pequenas e médias empresas tendem a mexer-se com mais velocidade. Muitas vezes não existe uma grande estrutura central que coordene tudo, mas a pressão para aumentar a produtividade e aliviar equipas é real. A IA acaba por funcionar como um “canivete suíço” digital: ajudar a pré-redigir contratos, criar anúncios de emprego, automatizar análises em Excel e polir apresentações.

Já as grandes organizações avançam mais devagar, mas com maior método. Normalmente começam com grupos-piloto, constroem regras internas, envolvem o encarregado de proteção de dados (DPO) e tentam estabelecer padrões comuns entre diferentes locais e equipas. A mensagem é consistente: a IA passou a ser encarada como um tema estratégico e veio para ficar.

Um ponto muitas vezes ignorado: mudança cultural e gestão de adopção

Além da tecnologia, há um factor decisivo: a forma como as pessoas integram a IA no trabalho. Quando não existe orientação, cada equipa inventa o seu “processo”, o que cria inconsistência, risco e perda de qualidade. Programas de formação em IA bem desenhados incluem práticas de revisão, regras de aprovação e exemplos do dia a dia para transformar curiosidade em utilização responsável - e repetível.

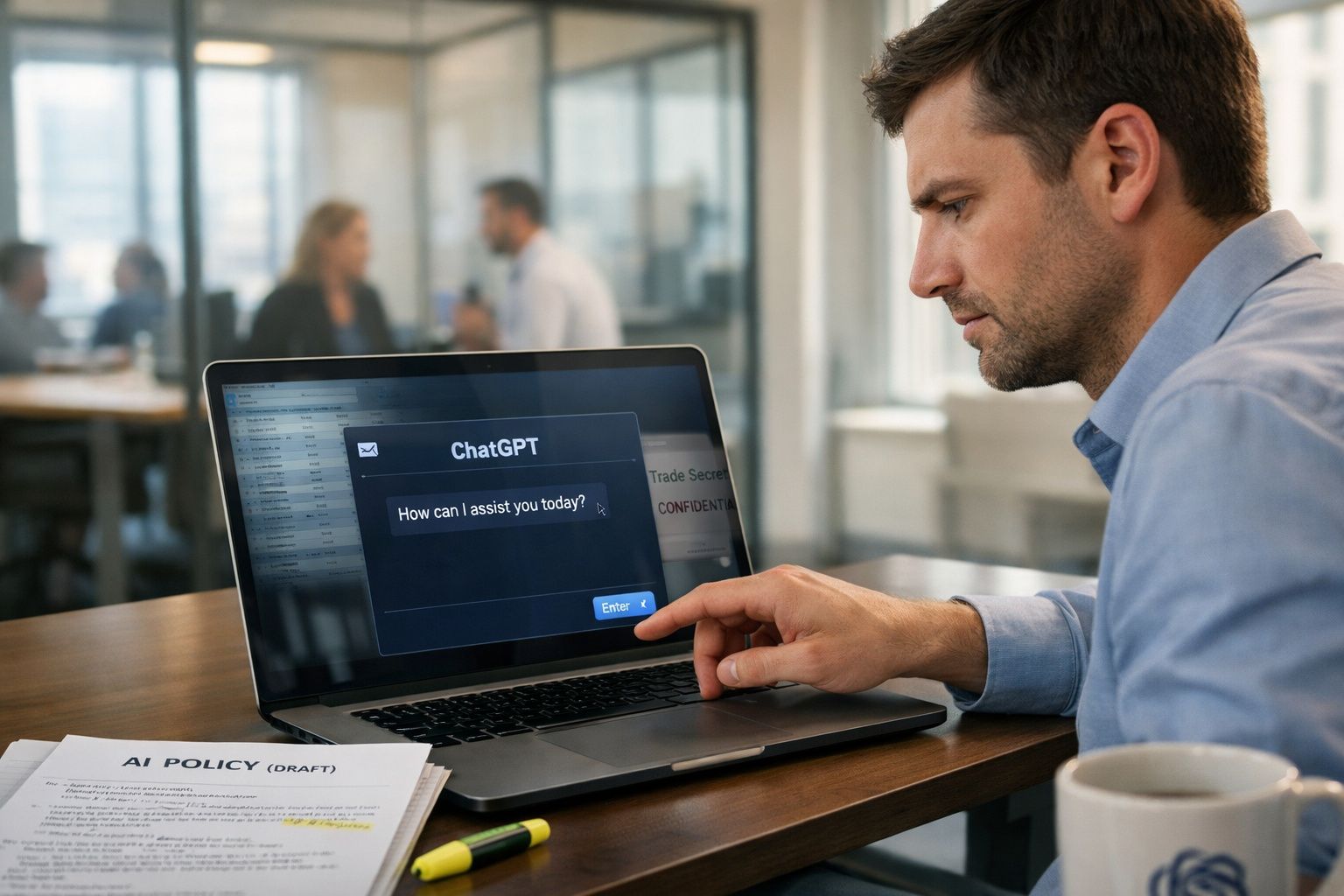

Perigo silencioso: a versão gratuita no dia a dia

Enquanto a gestão de topo ainda planeia avaliações e projectos, muitas equipas já fizeram avançar o tema por conta própria. O padrão é simples: abre-se a versão gratuita do ChatGPT no navegador e começa-se a usar. Um colega cola um rascunho de contrato, outro insere informação de clientes, outro pede à IA para reescrever um e-mail interno sensível.

A maioria não o faz por má intenção - quer poupar tempo, reduzir erros e escrever com mais clareza. O problema é que se esquece de um ponto crítico: o que é introduzido num modelo público de IA não pode, na prática, ser “desintroduzido”.

- Propostas e preços confidenciais passam a circular fora dos sistemas internos da empresa.

- Dados sensíveis de recursos humanos podem ser copiados para serviços baseados nos EUA ou noutros países.

- Estratégia, planos de produto e ideias de inovação acabam por alimentar sistemas externos.

Muitas equipas de TI descobrem, com surpresa, que já existe um “ecossistema sombra” de utilização não oficial de IA dentro da organização. Alguns responsáveis de segurança resumem a situação assim: “As pessoas usam a versão gratuita do ChatGPT e nem se apercebem dos dados que estão a expor.”

Proteção de dados, segredos comerciais e responsabilidade: onde a situação se torna crítica

Os riscos não são teóricos - e atingem vários pontos em simultâneo. Em particular, há três áreas que costumam preocupar juristas e especialistas de proteção de dados.

1) Proteção de dados de clientes

Assim que nomes, e-mails, contratos ou informação clínica entram numa ferramenta de IA, abre-se um verdadeiro campo minado do ponto de vista legal. Sem um contrato de subcontratação (tratamento por conta do responsável), sem base legal clara e sem informação transparente aos titulares, um incumprimento do RGPD pode tornar-se realidade rapidamente - com coimas associadas.

O mais delicado é que muitos colaboradores não sabem se a ferramenta usa dados para treino, nem onde os armazena (por exemplo, em servidores em países terceiros). Um chatbot “inofensivo” no browser pode transformar-se num exportador de dados não controlado.

2) Perda de segredos comerciais

Cálculos internos, roadmaps de produto, código-fonte, dados de investigação - é isto que distingue uma empresa. Se esse conteúdo for introduzido em modelos de IA acessíveis publicamente, pode reaparecer mais tarde de forma agregada ou escapar por falhas de segurança.

Mesmo quando um fornecedor garante que não usa as entradas para treino, permanece um risco residual: configurações incorrectas, ataques informáticos e fluxos de dados pouco claros dentro de plataformas complexas. Agir com leviandade aqui pode colocar o próprio modelo de negócio em causa.

3) Responsabilidade e resultados errados

Ferramentas de IA apresentam respostas com grande confiança e uma aparência “limpa”. No entanto, podem inventar fontes, criar decisões judiciais inexistentes ou baralhar factos. Se as equipas confiarem demais, o custo pode ser elevado: aconselhamento jurídico errado, análises financeiras falhadas, textos médicos ambíguos ou instruções técnicas perigosas.

A maior ilusão é acreditar que a IA está sempre certa - apenas porque escreve com fluidez.

Quem trabalha com IA em contexto profissional precisa, no mínimo, de competência metodológica: como validar respostas, que tarefas são adequadas e quais são proibidas, e em que momentos é obrigatório pedir revisão a especialistas.

Um novo factor a considerar: regras e auditoria (incluindo o Regulamento Europeu da IA)

Para além do RGPD e da confidencialidade, as empresas começam a preparar-se para exigências de governação, documentação e transparência que o Regulamento Europeu da IA (AI Act) e normas internas podem implicar, consoante o caso de uso. Isto aumenta a necessidade de políticas claras, registos do que foi feito (auditoria) e critérios sobre que modelos e fornecedores podem ser usados.

Porque é que as empresas estão a investir agora em formação em IA

Apesar dos riscos, muitas administrações olham sobretudo para a oportunidade. Procuram equipas mais produtivas, menos tarefas rotineiras e mais tempo para aconselhamento, criatividade e contacto com clientes. Num contexto de escassez de talento, a IA bem implementada pode até ajudar a cobrir lacunas.

Hoje, a formação raramente se limita a “como escrever prompts”. O que se pede são cenários realistas, alinhados com o trabalho diário:

- Como é que vendas produz propostas mais depressa, sem expor margens confidenciais?

- Como podem os recursos humanos preparar anúncios e conversas de feedback sem violar direitos de personalidade?

- Como utiliza o departamento jurídico a IA para pesquisa, sem acabar a responder por citações falsas?

Formadores relatam um padrão recorrente: quando surgem exemplos concretos da própria organização, o ambiente muda. A desconfiança inicial dá lugar à curiosidade - e a utilização “selvagem” sem regras transforma-se num processo estruturado e rastreável.

Da cultura de proibição às “guardas” (regras práticas)

Algumas empresas reagem por reflexo com proibições. Bloqueiam o ChatGPT e serviços semelhantes na rede corporativa, enviam avisos por e-mail e ameaçam com consequências disciplinares. A curto prazo, isto pode travar parte do risco de fuga de dados; a longo prazo, raramente acompanha a realidade.

Em muitos casos, resulta melhor definir guardas claras em vez de um bloqueio total, por exemplo:

- Uma política simples e compreensível para utilização de serviços de IA.

- Ferramentas aprovadas com condições de proteção de dados verificadas.

- Formação interna que apresente, em simultâneo, vantagens e riscos.

- Pontos de contacto em TI, jurídico e proteção de dados para dúvidas.

Além disso, várias empresas estão a optar por soluções internas de IA. Nesse modelo, as ferramentas correm em servidores próprios ou em fornecedores de cloud rigorosamente avaliados, permitindo proteger melhor dados sensíveis, mantendo funcionalidades de conveniência semelhantes às dos serviços públicos.

Como identificar boa formação em IA

O mercado de formação é confuso. Há fornecedores que prometem ganhos “revolucionários” de produtividade e acabam por entregar apresentações genéricas, sem ligação ao trabalho real. Ao contratar, convém avaliar com cuidado.

| Critério | Como se percebe na prática |

|---|---|

| Orientação para a prática | Trabalho com exemplos reais da empresa, não apenas slides |

| Foco em proteção de dados | Indicações concretas sobre tipos de dados, retenção e limites legais |

| Conhecimento do sector | O formador domina processos típicos e terminologia da área |

| Sustentabilidade | Materiais, guias e contactos para apoio após o workshop |

Ao cumprir estes pontos, evita-se a típica “formação PowerPoint” que termina e deixa toda a gente na mesma: sem saber o que fazer de forma diferente no dia seguinte.

Como os colaboradores podem trabalhar com ChatGPT & Co. em segurança

O maior factor de redução de risco está nas pessoas. Com regras simples, o risco no quotidiano diminui de forma significativa:

- Não copiar para ferramentas públicas de IA dados reais de clientes, informação de saúde ou listas salariais.

- Anonimizar ou alterar de forma forte os trechos sensíveis antes de os usar.

- Rever criticamente os resultados e nunca os adoptar sem validação.

- Em caso de dúvida, falar primeiro com TI ou com o encarregado de proteção de dados.

Em paralelo, a IA pode elevar a qualidade do trabalho: e-mails mais bem estruturados, planos de projecto mais claros e análises produzidas com maior rapidez. Equipas que usam a ferramenta com disciplina relatam, muitas vezes, mais foco nas tarefas nucleares.

Porque esperar é a opção mais arriscada

Enquanto algumas empresas já aceleram, outras tentam “aguentar” a onda. No dia a dia, isso raramente funciona: as pessoas já conhecem ferramentas de IA do uso pessoal e levam naturalmente esses hábitos para o escritório.

Quando o empregador não define regras, nem formação, nem estratégia, a organização entrega o controlo ao acaso. Passa a ser cada colaborador a decidir quanta informação confidencial partilha e até que ponto confia em respostas da IA.

No médio e longo prazo, tende a afirmar-se um padrão claro: as empresas que investem cedo em competências, políticas transparentes e soluções seguras conseguem tirar produtividade da IA - em vez de, mais tarde, terem de reparar incidentes de dados, riscos legais e quebras de eficiência.

Comentários

Ainda não há comentários. Seja o primeiro!

Deixar um comentário